Kioxia ra mắt mô-đun flash 5TB, 64 GB/s đưa NAND tiến gần hơn tới bus bộ nhớ cho GPU AI — Nguyên mẫu HBF mang dáng dấp SSD quen thuộc

Kioxia vừa phát triển nguyên mẫu mô-đun bộ nhớ flash băng thông cao (High Bandwidth Flash – HBF) dung lượng 5TB với băng thông 64 GB/s. Đây có thể coi như bộ nhớ NAND dành cho GPU. So với HBM, HBF dựa trên NAND flash mang lại dung lượng cao hơn gấp 8–16 lần so với HBM dựa trên DRAM. Bằng cách kết hợp tốc độ cùng khả năng lưu trữ bền vững, HBF cho phép các tập dữ liệu AI khổng lồ được truy cập hiệu quả hơn trong khi tiêu thụ ít điện năng hơn.

Nếu nhắc đến “bộ nhớ flash”, đa số người dùng sẽ nghĩ tới dung lượng trước, tốc độ sau. Nhưng ngay cả những SSD PCIe 5.0 nhanh nhất hiện nay – như Samsung 9100 Pro với 14 GB/s – cũng không thể đáp ứng được nhu cầu băng thông ngày càng tăng của GPU và CPU hiện đại. Nguyên mẫu HBF mới của Kioxia đã thay đổi điều đó: một mô-đun flash 5TB có thể đạt 64 GB/s băng thông liên tục thông qua PCIe 6.0. Con số này nhanh hơn hơn 4 lần so với SSD PCIe 5.0 nhanh nhất hiện nay và tiệm cận băng thông của HBM2E.

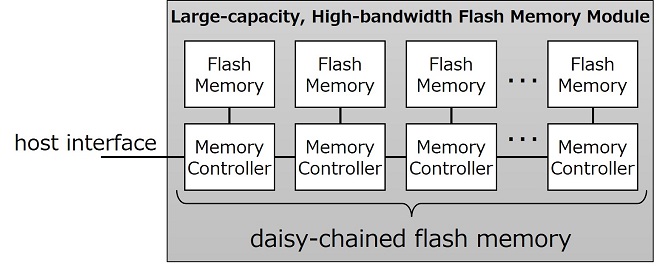

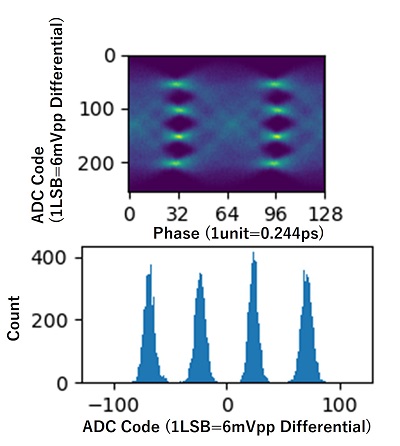

Điểm mấu chốt nằm ở cách Kioxia phân tán bộ điều khiển: thay vì một bộ điều khiển trung tâm quản lý toàn bộ NAND (dễ gây nghẽn cổ chai khi mở rộng), mỗi mô-đun HBF sẽ có bộ điều khiển riêng, đặt ngay cạnh NAND và kết nối chuỗi với các mô-đun khác. Nhờ đó giảm xuyên nhiễu và loại bỏ sự phức tạp của bus song song rộng. Mỗi liên kết có thể đẩy 128 Gbps bằng tín hiệu PAM4 (Pulse Amplitude Modulation 4 mức), công nghệ cũng đang được PCIe 6.0 áp dụng.

Tuy nhiên, HBF vẫn có độ trễ cao hơn nhiều so với HBM: trong khi HBM xử lý trong hàng trăm ns, NAND flash thường mất đến hàng chục µs. Để khắc phục, Kioxia tích hợp bộ đệm, prefetch và caching ở cấp độ bộ điều khiển, giúp giảm ảnh hưởng với các tác vụ tuần tự, đặc biệt hữu ích cho xử lý dataset AI, checkpoint hay phân tích đồ thị lớn.

Về hiệu suất năng lượng, mỗi mô-đun HBF tiêu thụ dưới 40W, trong khi SSD Gen5 ~14 GB/s đã có thể ngốn tới 15W. Tính theo GB/s trên mỗi Watt, HBF vượt trội rõ rệt. Điều này rất quan trọng với trung tâm dữ liệu AI, nơi hàng trăm ổ lưu trữ có thể tiêu tốn hàng kW điện năng, trong khi cụm GPU H100 đã khiến chi phí điện tăng vọt.

Tin liên quan

Tin liên quan

Sản phẩm mới

Sản phẩm mới